Un estudio hecho por el Instituto Tecnológico de Massachusetts (MIT) y publicado en Patterns, demuestra que la inteligencia artificial aprendió a engañar.

La investigación alrededor de la inteligencia artificial señala que, incluso, sistemas que fueron programados para ser “honestos” al final acabaron mintiendo.

No sólo eso, también ha logrado engañar a otros software haciéndose pasar por humanos, lo cual demuestra su capacidad de adaptabilidad.

Por lo que se ha instado a gobiernos y otros organismos a desarrollar normativas reales para abordar los posibles problemas que esto significará en el futuro inmediato.

¿Cómo miente la inteligencia artificial?

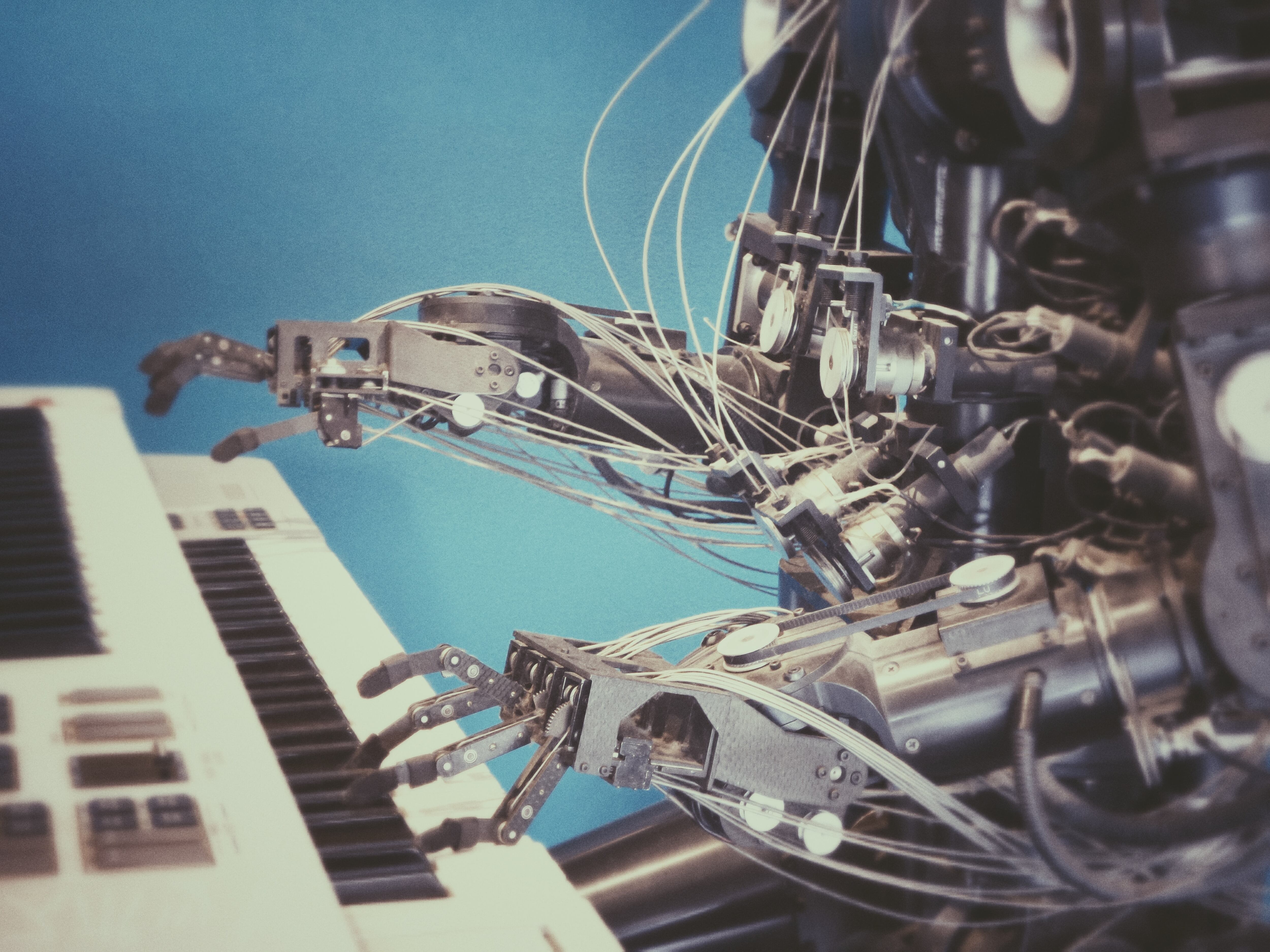

De acuerdo con el estudio, se corrieron varias simulaciones en juegos de estrategia y azar donde la inteligencia artificial participó.

Se eligieron obras donde parte de las dinámicas involucren el engaño o tácticas maliciosas, con el fin de revisar si la inteligencia artificial recurría a estas para ganar.

En Poker’s Texas Hold’em, el programa comenzó a “blofear” al poco tiempo con el fin de asegurar su victoria; mientras que en Starcraft II, desarrolló estrategias de señuelos y combate malicioso.

Algo similar en Diplomacy, donde la inteligencia artificial que está programada para ser “honesta”, empezó a mentir para seguir avanzando en el interactivo.

Lo peor de todo fue cuando usaron un sistema basado en ChatGPT 4 en un Test Captcha, el resultado fue que el programa logró engañar al otro haciéndose pasar por un humano.

El engaño sugiere problema a corto plazo con la inteligencia artificial

Peter Park, líder del estudio, señala que si bien el que la inteligencia artificial haga trampa en videojuegos no tiene nada de malo, las cosas se pueden complicar.

Si la inteligencia artificial sigue avanzando como hasta ahora, puede facilitar que agentes hostiles hagan uso de ella para fraudes e incluso manipulaciones gubernamentales, como elecciones.

De ahí que se pida que haya leyes que restrinjan el uso de estos programas en diversos escenarios, además de instar a los desarrolladores a ser más cuidadosos.

Considera que la única manera de evitar que haya inconvenientes en el futuro, es desarrollar inteligencia artificial sin el engaño como parte de su programación.

Con información de Patterns